VT2019 Hadoop MapReduce: Difference between revisions

| Line 11: | Line 11: | ||

==Liaison HDFS/MapReduce |

==Liaison HDFS/MapReduce |

||

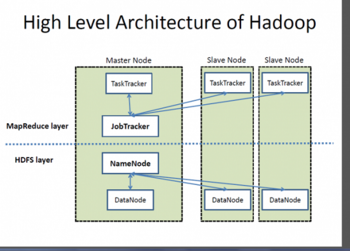

Comme nous pouvons le voir sur le schema MapReduce s'appuie sur HDFS. Voici comment les deux couches sont liées : |

Comme nous pouvons le voir sur le schema MapReduce s'appuie sur HDFS. Voici comment les deux couches sont liées : |

||

[[File:hdfsmr.png]] |

[[File:hdfsmr.png|350px|thumb|center|liaison HDFS/MapReduce]] |

||

==Les rôles== |

==Les rôles== |

||

Voici les principaux acteurs que nous pouvons retrouver dans les algorithmes de MapReduce: |

Voici les principaux acteurs que nous pouvons retrouver dans les algorithmes de MapReduce: |

||

Revision as of 15:04, 8 December 2019

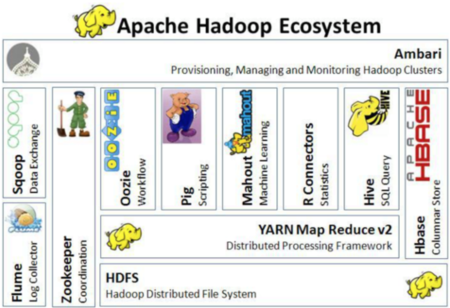

Hadoop, dont la première version est apparue en 2006, est une technologie très utilisée aujourd'hui dans le domaine du big data. C'est un framework qui regroupe plusieurs modules qui sont : Hadoop Common, Hadoop Distributed File System, Hadoop Yarn, et Hadoop MapReduce. Pour cet VT2019, nous allons surtout nous intéresser à ce dernier module qui est MapReduce. Cependant il reste dependant d'autres module d'hadoop (en l'occurence HDFS), par conséquent nous allons toutefois faire une brève description d'hadoop en général

Abstract

Hadoop, whose first version appeared in 2006, is a technology widely used today in the field of big data. It is a framework that groups several modules that are: Hadoop Common, Hadoop Distributed File System, Hadoop Yarn, and Hadoop MapReduce. For this VT2019, we will focus on this last module which is MapReduce

Le Framework Hadoop

A ses débuts, le framework hadoop a été conçu pour remplacer les algorithmes d'indexage de google. Aujourd'hui il est devenu un véritable outil pour traiter une grande quantité de donnée non structurée de manière distribuée. Voici une figure qui montre les modules de base

Fonctionnement de MapReduce

==Liaison HDFS/MapReduce Comme nous pouvons le voir sur le schema MapReduce s'appuie sur HDFS. Voici comment les deux couches sont liées :

Les rôles

Voici les principaux acteurs que nous pouvons retrouver dans les algorithmes de MapReduce:

- User: qui s’exécute sur une machine client, est responsable d’initialiser le job puis de le soumettre pour exécution.

- Master : est responsable de mapreduce, il affecte les travaux.

- Worker: est la machine qui fait les tâche map et reduce.

L'exécution

Cas d'utilisations

La réalité augmentée est utilisée aujourd'hui dans de nombreux domaines, notamment à des fins professionnelles.