Difference between revisions of "VT2020-Micronaut-Fiche"

| Line 1: | Line 1: | ||

=Présentation= |

=Présentation= |

||

| ⚫ | |||

Micronaut est un framework full-stack Java moderne, basé sur la JVM, créé pour construire des applications de microservices, Serverless modulaires, facilement testables avec un support pour Java, Kotlin et le langage Groovy adaptés au JDK et à GraalVM. |

Micronaut est un framework full-stack Java moderne, basé sur la JVM, créé pour construire des applications de microservices, Serverless modulaires, facilement testables avec un support pour Java, Kotlin et le langage Groovy adaptés au JDK et à GraalVM. |

||

Micronaut est développé par les créateurs du framework Grails et sponsorisé par Object Computing, Inc. |

Micronaut est développé par les créateurs du framework Grails et sponsorisé par Object Computing, Inc. |

||

* La première version de Micronaut (1.0.0) est sortie en 2018 |

* La première version de Micronaut (1.0.0) est sortie en 2018 |

||

* Il est open source sous licence Apache 2.0 |

* Il est open source sous licence Apache 2.0 |

||

| ⚫ | |||

=Fonctionnalités= |

=Fonctionnalités= |

||

Revision as of 18:32, 15 November 2020

Présentation

Micronaut est un framework full-stack Java moderne, basé sur la JVM, créé pour construire des applications de microservices, Serverless modulaires, facilement testables avec un support pour Java, Kotlin et le langage Groovy adaptés au JDK et à GraalVM. Micronaut est développé par les créateurs du framework Grails et sponsorisé par Object Computing, Inc.

- La première version de Micronaut (1.0.0) est sortie en 2018

- Il est open source sous licence Apache 2.0

Fonctionnalités

Micronaut s'inspire des Framework Spring, Spring Boot et Grails. Micronaut vise à fournir tous les outils nécessaires pour construire des applications JVM, y compris :

- Injection de dépendance et inversion de contrôle(IoC): Micronaut utilise les données à la compilation (compile time) pour mettre en œuvre l'injection de dépendance qui utiliser la réflexion qu'en dernier recours.

- Aspect Oriented Programming(AOP): Micronaut fournit une implementation d'AOP qui n'utilise pas la réflexion pour définir les préoccupations transversales(cross cutting concerns) (logging, transactions, tracing etc.)

- Sensible Defaults and Auto-Configuration:exemple Fast Access Configuration Micronaut fournit des valeurs par défaut raisonnables qui configurent automatiquement votre boîte à outils d'accès aux données et vos API préférées pour faciliter l'écriture de vos propres intégrations.

- Micronaut propose un modèle asynchrone et non bloquant et le rend donc indiqué pour développer des applications réactives. Pour cela la couche réseau est basée sur le serveur Netty qui apporte la gestion de l’event loop .

- Configuration d'accès des données avec les bases mongoDB, Neo4j, Postgres, Cassandra, Redis…

Résilience et tolérance aux fautes

- Mécaniques intégrées de retry et circuit breaker : être capable de se remettre d'echec est critique pour les clients HTTP et c'est là que les Retry Advice intégrés à Micronaut interviennent.

Cloud

- Configuration distribuée(HashiCorp Consul, AWS Parameter Store etc)

- Service Discovery (Consul, Eureka, Kubernetes …)

- Load Balancing (Équilibrage des charges) côté client

Les projets Micronaut peuvent également être générés à l'aide d'un générateur en ligne https://micronaut.io/launch/

Fonctionnement de MapReduce

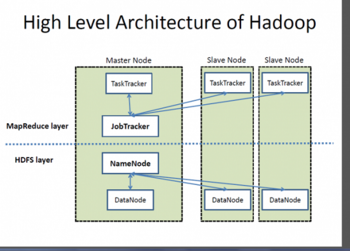

Liaison HDFS/MapReduce

Comme nous pouvons le voir sur le schema MapReduce s'appuie sur HDFS. Voici comment les deux couches sont liées :

Les rôles

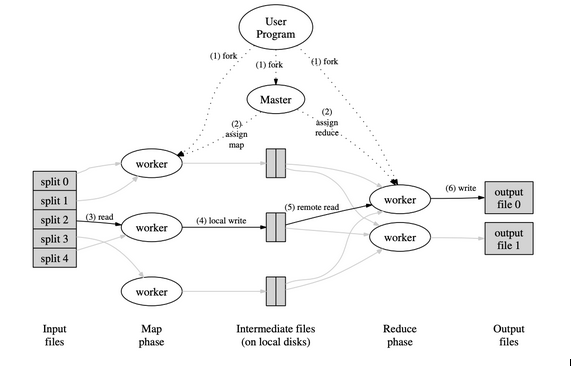

Voici les principaux acteurs que nous pouvons retrouver dans les algorithmes de MapReduce:

- User: qui s’exécute sur une machine client, est responsable d’initialiser le job puis de le soumettre pour exécution.

- Master : est responsable de mapreduce, il affecte les travaux.

- Worker: est la machine qui fait les tâche map et reduce.

L'exécution

- Etape 1: Dans un premier temps, la bibliothèque MapReduce dans le programme utilisateur divise les fichiers d'entrée M par pièce. Il démarre ensuite de nombreuses copies du programme sur un groupe de machines.

- Etape 2: L'une des copies du programme est spéciale - le master. Les autres sont des travailleurs qui sont affecté un travail par le master. Il y a M tâches de map et R reduce tâches. Le master choisit les travailleurs inactifs et attribue à chacun une tâche de map ou reduce.

- Etape 3: Un travailleur lit le contenu d'entrée correspondant. Il parse les paires key / value des données d'entrée et passe chaque paire à la fonction Map définie par l'utilisateur. Les nouveaux paires key2 / value2 intermédiaires produites par la fonction Map sont stocké dans la mémoire.

- Etape 4: Périodiquement, les paires dans le buffer sont écrites en local disque. Les emplacements de ces paires tamponnées sur le disque local est renvoyé au master.

- Etape 5: Le travailleur de reduce utilise des remote appels pour lire les données sur le disque des travailleurs map. Lorsqu'un travailleur a lu toutes les données intermédiaires, il les trie par les clés afin que toutes les occurrences de la même clé soient regroupées. Le tri est nécessaire car généralement de nombreuses clés différentes sont dans la même tâche de réduction.

- Etape 6: le travailleur de reduce transmet la clé et la valeur correspondante à la fonction de réduction de l'utilisateur. La sortie de reduce est ajoutée à un fichier de sortie final pour cette partition de réduction.

- Etape 7: Une fois il est la réussi, la sortie de l'exécution de mapreduce est disponible dans les R fichiers( 1 par 1 reduce tache)

Cas d'utilisations

L’exemple classique pour illustrer le fonctionnement de MapReduce est le Wordcount (cf. Démonstration). Cependant MapReduce permet aussi de faire autre choses comme : du grep distribué, du tri distribué, une analyse des journaux d'accès Web, une construction d'index inversé, un regroupement de documents, de l'apprentissage automatique, de la traduction automatique basée sur des statistiques, la génération d'un index de la recherche complète de Google, etc.

Avantages

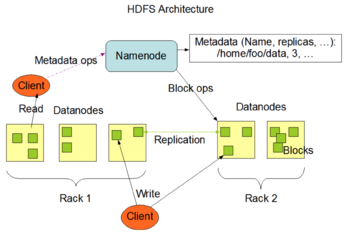

Les principaux avantage d'Hadoop sont sa haute scalabitilité et sa tolérance aux erreurs. La haute scalabité vient du fait que tout est conçu pour fonctionner dans un contexte distribué. On peut mettre autant de machine et de cluster que l'on veut, cela ne va pas impacter le traitement des données par mapreduce. La tolérance aux fautes vient du fait que MapReduce s'appuie sur HDFS - qui elle-même possède un système de replication des etats et des blocs de données entre les DataNode). Quand un noeud meurt, on peut facilement basculer sur un autre noeud.

Par ailleurs, par rapport à d'autres technologies du même type présentes sur le marché comme Teradata par exemple, Hadoop se distingue du fait qu'il soit open-source.

Inconvénients

Bibliographie

- https://pdos.csail.mit.edu/6.824/papers/mapreduce.pdf

- https://hadoop.apache.org/docs/current/hadoop-project-dist/hadoop-hdfs/HdfsDesign.html

- https://fr.wikipedia.org/wiki/Hadoop