EA2013 Vandalisme dans les Wiki

Présentation

- Enseignants : Georges-Pierre Bonneau, Didier Donsez (EA2013)

- Auteur : Jordan Calvi <Jordan.Calvi@e.ujf-grenoble.fr>

- Télécharger : Media:EA_2013_Vandalisme_dans_les_Wiki_Jordan_CALVI.pdf

Abstract

As numbers of contributors has increased exponientially in Wikipedia, the encyclopedia is highly enriched. However, it has also brought a lot of both incorrect and vandalism content. This article emphasizes the need to use anti-vandal tools implemented by the Wikipedian community for itself, so members can control the numerous changes that are made.

Keywords

Wikipedia, vandalism, anti-vandal tools, bot, cyborg

Résumé

Avec l'augmentation exponentielle du nombre de contributeurs sur Wikipédia, l'encyclopédie s'est fortement enrichie. Cependant, cela a amené aussi beaucoup de contenu erroné ainsi que des actes de vandalisme. Cet article insiste sur la nécessité d'utiliser des outils d'antivandalisme, mis en place par la communauté wikipédienne pour elle même, de telle sorte à pouvoir contrôler les nombreuses modifications effectuée.

Mots-clés

Wikipédia, vandalisme, outils d'antivandalisme, robot (bot), cyborg

Synthèse

Contexte

Le projet Wikipédia a été lancé le 15 janvier 2001 dans le but de mettre à disposition de tous une encyclopédie libre et éditable par chacun. Au lancement du projet, seul un nombre restreint de personnes contribue, compris entre 10 et 100. Dès 2004, Wikipédia connaît un engouement pour son encyclopédie. Ainsi, le nombre de contributeurs et d'éditions d'article commence à augmenter de manière exponentielle. En 2006, l'augmentation est la plus rapide. A ce stade, Wikipédia met déjà à disposition des outils permettant aux contributeurs de s'assurer de la cohérence des nombreux articles mis en lignes. Cette coissance exceptionnelle continua jusqu'en 2007, date à laquelle l'encyclopédie a déjà été massivement remplie. A partir de ce moment, le nombre de contributeurs diminue progressivement mais reste cependant très important.

Le vandalisme

Wikipédia est une encyclopédie en ligne permettant à n'importe quel internaute d'éditer un article sans même avoir à s'identifier. Ainsi, il est facile d'ajouter de l'information qui peut être erronée, non conforme aux conditions d'utilisation ou issue d'actes de vandalisme. La liste ci-dessous indique quelques cas à identifier par la communauté wikipédienne :

- Violations de copyright

- Articles diffamatoires

- Orthographe

- Vandalisme

- Suppression de contenu

- Ajout de contenu erroné

- Faux rollback

Les types d'outils d'antivandalisme

La communauté wikipédienne doit être en mesure de contrôler la véracité et l'intégrité des articles mis en ligne. Or, contenu de la quantité importante de contributions et d'éditions d'articles, les contrôles ne peuvent être intégralement effectués par de seuls humain. En effet, les annulations de contenu doivent être effectuées très rapidement avant que le contenu erroné ne soit visulalisé par des internautes et qu'il soit mis en cache par les moteurs de recherche.

Pour luter plus efficassement contre le vandalisme, des programmes de deux types sont utilisés.

Les robots (bots)

Les robots sont apparus comme étant une première manière d'éliminer une grande quantité des moditifations issues du vandalisme basique. En effet, ils sont autonomes et permettent aux humains de se focaliser sur le vandalisme plus difficile à détecter. Pour ne pas être perçu comme des barrières aux nouveau contributeurs, les messages de suppression qui sont envoyés au contributeurs sont rédigés en utilisant un langage naturel expliquant l'action réalisée. De plus, les robots fonctionnent avec des comptes utilisateurs sur Wikipédia.

Un article référence les bots utilisés par l'encyclopédie en ligne et les classe selon le nombre d'éditions effectuées : List_of_bots_by_number_of_edits.

AntiVandalBot

AntiVandalBot fait parti de la première génération de robot ayant pour vocation de lutter contre le vandalisme. Celui est basé sur de simples règles utilisant des listes noires et des partons. Ainsi, lorsqu'un test est effectué sur une édition d'article, si le résultat de celui-ci est vrai alors le robot annule la modification et restaure la version précédente. De cette manière, le robot peut lutter contre le vandalisme le plus évident et éliminer automatiquement une part d'éditions non souhaitées.

ClueBot_NG

ClueBot_NG est un robot de nouvelle génération succedant à AntiVandalBot. Celui-ci apporte certaines améliorations par rapport à son précésseur, notamment :

- La détection de 40% du vandalisme total avec un taux de faux positifs réduit à 0,1%;

- Basé sur l'autoapprentissage de règles : il examine une liste d'éditions (appelée "corpus" or "dataset") pré-classées en légitime ou vandal pour construire ses règles.

Les cyborgs

Puisque les robots de sont pas capable de détecter le vandalisme poussé, l'humain doit être solicité. Etant donné le nombre important d'actes de vandalisme restant malgré la première barrière mise en place par les robots, la communauté wikipédienne ne peut pas gérer cela sans outils. Ainsi, des programmes appelés "cyborgs" viennent en complément des robots. Ils permettent de fournir des indications à l'utilisateurs pour identifier plus facilement les contributions les plus succeptibles d'être des actes de vandalisme. L'utilisateur peut alors au sein de l'application déclancher une action comme signaler la contribution comme étant un acte de vandalisme, donner un avertissement au contributeur et supprimer la modification.

VandalProof

VandalProof est un des premiers cyborgs mis à disposition pas la communauté wikipédienne pour le projet anglophone, permettant de simplifier les actions de recherche contributions récentes et potentiellements frauduleuses puis de les révauquer. Les fonctionnalité principales sont citées ci-dessous :

- Surveiller les modifications récentes (Recent Changes)

- Visualisation des contributions d'un utilisateur

- Actions en un clic

- Révoquer une édition

- Poster un message d'avertissement

- Insérer le contributeur dans la liste noire

- Mettre à jour le journal de vandalisme

Huggle

Le cyborg Huggle est le successeur de VandalProof le plus connu. Il apporte des améliorations, notamment au niveau de l'interface avec une IHM conviviale et efficasse. Il est aujourd'hui en développement dans ça version 3.0 et est disponible en pour le test.

Ce programme peut être utilisé par n'importe quel utilisateur enregistré sur Wikipédia ayant rempli un article de configuration, activant l'accès aux fonctionnalités proposées par le logiciel. En effet, aucune restriction n'est mise en place sur la version francophone de l'encyclopédie. Cependant, à chaque contributeur est associé un taux de mauvaises contributions. Associé à une liste noir, cela permet de limiter les abus. Sur d'autres projets tels que la version hispanophone, un utilisateur ne peut utiliser l'application uniquement après avoir effectuer au moins 50 contributions valides.

Démonstration

Robot

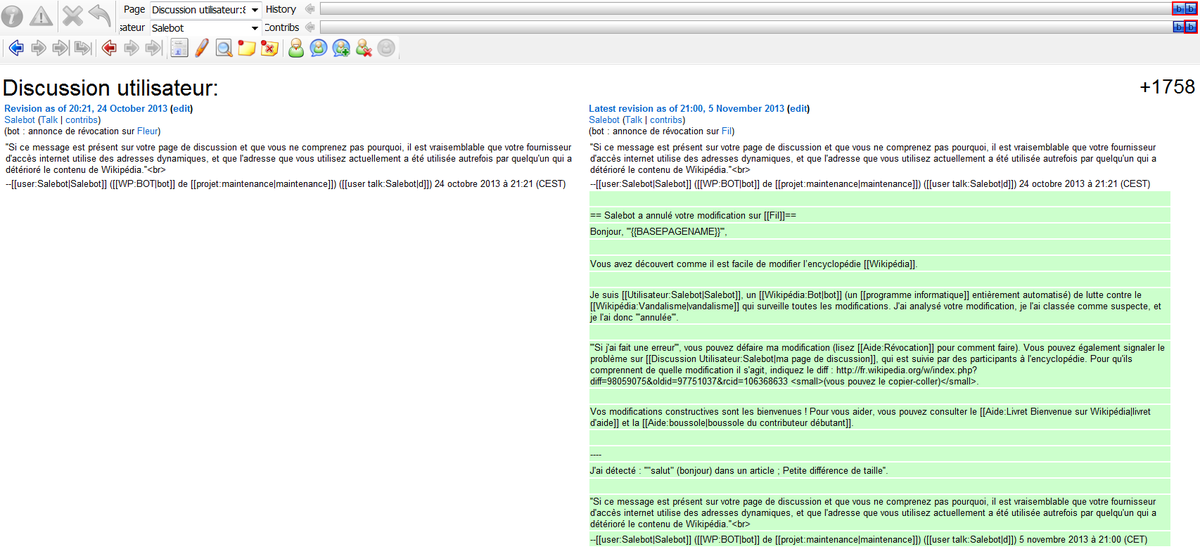

- Détection de "Salut tout le monde!" comme "Bonjour" et message émis par le robot Salebot en langage naturel :

Cyborg

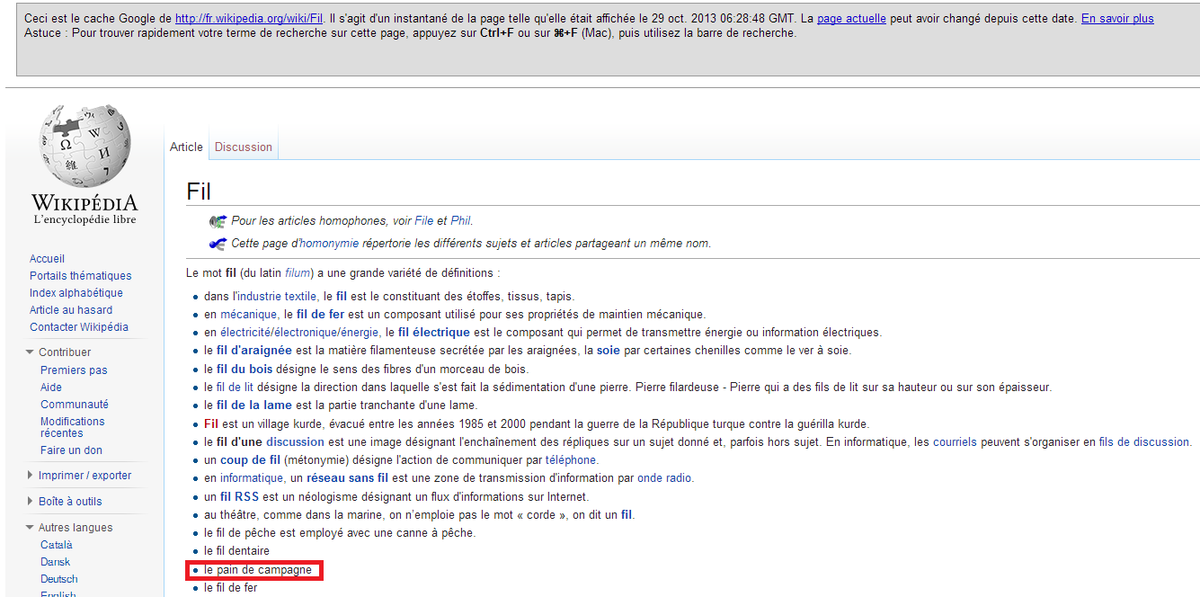

- Démonstration de Huggle avec capture Huggle (pour SALUT ! avant suppression bot) + cache Google

Pour pouvoir utiliser le cyborg Huggle sur le projet francophone de Wikipédia, il faut disposer d'un compte utilisateur et avoir rempli la page de configuration "http://fr.wikipedia.org/wiki/Utilisateur:NomDuCompteUtilisateur/huggle.css" comme suit :

enable:true

version:2.1.21

admin:true

patrol-speedy:true

speedy-message-title:

report-summary:Reporting [[Special:Contributions/$1|$1]]

prod-message-summary:Notification: Proposed deletion of [[$1]]

warn-summary-4:Avertissement niveau 4 [[$1]]

warn-summary-3:Avertissement niveau 3 [[$1]]

warn-summary-2:Avertissement niveau 2 [[$1]]

warn-summary:Message avertissement[[$1]]

auto-advance:false

auto-whitelist:true

confirm-multiple:false

confirm-range:true

confirm-page:true

confirm-same:true

confirm-self-revert:true

confirm-warned:true

default-summary:Révocation des modifications de [[Special:Contributions/$1|$1]] ([[Discussion utilisateur:$1|d]]) (retour à la dernière version de $2)

diff-font-size:8

extend-reports:true

irc-port:6667

prod-log:False

minor:revert

open-in-browser:false

preload:2

report:none

revert-summaries:

Révocation suppression de contenu non justifiée,

Révocation ajout de [[WP:BPV|contenu négatif non sourcé]] à un article biographique,

Révocation ajout de contenu douteux non sourcé,

Révocation ajout de contenu non sourcé et/ou suppression de contenu non justifiée

customtsumm:false

rollback:true

show-log:true

show-new-edits:true

show-queue:true

show-tool-tips:true

templates:

Adding copyrighted material;uw-copyright,

Conflict of interest;uw-coi,

Cut-paste page move;uw-c&pmove,

Edit summaries;uw-editsummary,

Inserting external links to images;uw-imageuse,

Reverting self tests;uw-selfrevert,

Inserting copyrighted lyrics;uw-lyrics,

Removing deletion tags;uw-speedy,

Signing articles;uw-articlesig,

Unnecessarily changing between English variants;uw-lang,

Unsourced contributions;uw-unsourced,

Edit warring;uw-3rr1

tray-icon:false

undo-summary:Annulation de ma propre édition

update-whitelist:true

username-listed:true

watch:blocknote,delete,deletenote,deletetag,prodtag,speedytag

Dans un premier exemple, l'élement "Salut tout le monde!" est inséré dans la liste. Il apparait alors dans le cyborg Huggle. La révaucation est cependant effectué par un robot qui a détecté "salut" comme étant un synonyme de "bonjour", lui-même black-listé.

Un exemple de vandalisme est présenté ci-après. L'élément "pain de campagne" a été ajouté à la liste des définitions du mot "fil". Or, celui-ci est complètement hors-sujet. Bien que la modification soit apparue dans Huggle, celle-ci n'a pas été révoquée, ni par un robot, ni par un membre de la communauté pouvant utilisé un cyborg. De plus, cette modification est toujours présente deux semaines plus tard. L'article a été mis en cache par un moteur de recherche dont le robots ne passe qu'environ tous les 15 jours.

Conclusion

Avec un nombre important de modifications effectuées sur les projets Wikipédia, des outils ont du être mis en place par la communauté Wikipédia pour lutter contre l'ajout de contenu erroné. Pour cela, deux outils sont utilisés en parallèle : les robots et les cyborgs. La combinaison de ces deux types de programme permet d'éliminer l'eseentiel du vandalisme en limitant le nombre de faux positifs. Cependant, comme constaté lors de la démonstration, il est possible que certain actes de vandalisme échappent au contrôle. Cela a pour conséquence de laisser à disposition des internautes non averti de informations qui peuvent être erronées et mises en cache par les moteurs de recherche. Ce type de problème concerne uniquement les articles peu visités.