ECOM2016 LaReleve - Deploiement

Déploiements

Ayant 5 machines à disposition, nous avons mis en place le déploiement suivant :

On trouve dans ce déploiement : - front-LaReleve : le client de notre application angular frontend - deux HaProxy : un proxy permettant un load balancing entre deux instances de API-LaReleve - deux API-LaReleve : notre API JEE - deux Mysql-GR : Conteneur stockant notre base de donnée et mis en lien pour que leurs contenus ne diffèrent jamais (une opération dans une base implique la mise à jour de l'autre) - Hawkular services - Cassandra - Grafana

Composition docker

Sur chaque machines, uniquement des conteneur docker sont exécuté. Pour les contrôles facilement, des compositions docket ont donc été décrites. Voici ces compositions et les fichiers de configuration nécessaires à leurs fonctionnement :

ECOM-1 et ECOM-2

Sur les serveurs ECOM-1 et ECOM-2 se trouvent un conteneur HAPROXY effectuant un load balancing sur deux serveur executant API-LaReleve. Effectuant du ssh, un script generate.sh a été créé pour créer facilement des certificats auto-signés. Les deux machines exécutent exactement les mêmes conteneurs et ont exactement la même configuration. Seul les certificats pour effectuer du http sont différents puisqu'il sont associé aux noms de domains liés au machine ECOM-1 et ECOM-2.

docker-compose.yml

1version: '2'

2

3services:

4 haproxy:

5 image: 'haproxy:latest'

6 ports:

7 - '443:443'

8 volumes:

9 - './haproxy/etc/ssl:/etc/ssl'

10 - './haproxy/usr/local/etc/haproxy:/usr/local/etc/haproxy'

11 - './haproxy/dev/log:/dev/log'

generate.sh

1#!/bin/bash

2

3mkdir -p haproxy/etc/ssl

4

5# Certs

6openssl genrsa -out haproxy/etc/ssl/air.key 2048

7openssl req -new -key haproxy/etc/ssl/air.key -multivalue-rdn -subj "/C=FR/L=GRENOBLE/O=UGA/O=POLYTECH/OU=RICM/CN=AIR/emailAddress=air@imag.fr" -out haproxy/etc/ssl/air.csr

8openssl x509 -req -days 365 -in haproxy/etc/ssl/air.csr -signkey haproxy/etc/ssl/air.key -out haproxy/etc/ssl/air.crt

9cat haproxy/etc/ssl/air.crt haproxy/etc/ssl/air.key | tee haproxy/etc/ssl/air.pem

10

11# Dhparam

12openssl dhparam -out haproxy/etc/ssl/dhparam.pem 2048

haproxy/usr/local/etc/haproxy/haproxy.cfg

1global

2 log /dev/log local0

3 log /dev/log local1 notice

4 chroot /root/

5 stats socket /var/run/haproxy.sock mode 660 level admin

6 stats timeout 30s

7 daemon

8

9 # Default ciphers to use on SSL-enabled listening sockets.

10 # For more information, see ciphers(1SSL). This list is from:

11 # https://hynek.me/articles/hardening-your-web-servers-ssl-ciphers/

12 ssl-default-bind-ciphers ECDH+AESGCM:DH+AESGCM:ECDH+AES256:DH+AES256:ECDH+AES128:DH+AES:ECDH+3DES:DH+3DES:RSA+AESGCM:RSA+AES:RSA+3DES:!aNULL:!MD5:!DSS

13 ssl-default-bind-options no-sslv3

14

15defaults

16 # log global

17 mode http

18 option httplog

19 option dontlognull

20 timeout connect 5000

21 timeout client 50000

22 timeout server 50000

23

24

25frontend localhost

26 bind *:80

27 mode http

28 default_backend nodes

29

30frontend localhostS

31 bind *:443 ssl crt /etc/ssl/air.pem

32 mode http

33 default_backend nodes

34

35# JavaEE servers are javaee01 and javaee02

36backend nodes

37 mode http

38 balance roundrobin

39 option forwardfor

40 option httpchk HEAD / HTTP/1.1\r\nHost:localhost

41 server ecom03 ecom-3:8080 check

42 server ecom04 ecom-4:8080 check

43 http-request set-header X-Forwarded-Port %[dst_port]

44 http-request add-header X-Forwarded-Proto https if { ssl_fc }

ECOM-3 et ECOM-4

Sur les serveurs ECOM-3 et ECOM-4 se trouvent API-LaReleve et les base de données associés à chacune. Avec l'utilisation de l'image docker Mysql-GR et la mise en place de paramètres dans la commande de lancement du conteneurs, les bases de données sont configurés en Group Replication. Cela veut dire que si une action est effectué sur une des deux bases, elle est immédiatement répliquer sur l'autre.

Les noeuds sont lancés exactement de la même manière. Il faut pour cela récupéré le projet API-Runtime (dépot) et lancer la composition après avoir configuré les variables d'environnement et la commande de lancement du conteneur mysql-gr.

docker-compose.yml

1version: '2'

2services:

3 wildfly:

4 image: gattazr/lareleve:latest

5 ports:

6 - '8080:8080'

7 - '9990:9990'

8 environment:

9 JAVA_OPTS: '-server -Xms64m -Xmx512m -XX:MetaspaceSize=96M -XX:MaxMetaspaceSize=256m -Djava.net.preferIPv4Stack=true -Djboss.modules.system.pkgs=org.jboss.byteman -Djava.awt.headless=true -Dcom.sun.jersey.server.impl.cdi.lookupExtensionInBeanManager=true'

10 #### Wildfly administration

11 # ACTIVATE_ADMIN: 1

12 # ADMIN_USERNAME: 'admin'

13 # ADMIN_PASSWORD: 'admin123456'

14 #### Mysql

15 # MYSQL_HOST: 'mysqldb:3306'

16 # MYSQL_DATABASE: 'lareleve'

17 # MYSQL_USER: 'lareleve'

18 # MYSQL_PASSWORD: 'lareleve123'

19 #### Hawkular

20 # HAWKULAR_HOST: '192.168.99.100:8080'

21 # HAWKULAR_USERNAME: 'jdoe'

22 # HAWKULAR_PASSWORD: 'password'

23 volumes:

24 - ./data/wildfly/log:/opt/jboss/wildfly/standalone/log

25# - ./data/wildfly/deployments/:/opt/jboss/wildfly/standalone/deployments/

26 mysqldb:

27 image: 'mysql/mysql-gr:latest'

28 ports:

29 - '3306:3306'

30 - '6606:6606'

31 environment:

32 MYSQL_DATABASE: 'lareleve'

33 MYSQL_USER: 'lareleve'

34 MYSQL_PASSWORD: 'lareleve123'

35 MYSQL_ROOT_PASSWORD: 'mysqldb123'

36 MYSQL_REPLICATION_USER: 'rpl_user'

37 MYSQL_REPLICATION_PASSWORD: 'rpl_pass'

38 volumes:

39 - ./schema.sql:/docker-entrypoint-initdb.d/schema.sql:ro

40 - mysqlVolume:/var/lib/mysql

41 command: sh -c '/entrypoint.sh --group_replication_group_seeds="" --server-id=1'

42# command: sh -c '/entrypoint.sh --group_replication_group_seeds="ecom4:6606" --server-id=1'

43# command: sh -c '/entrypoint.sh --group_replication_group_seeds="ecom3:6606" --server-id=2'

44volumes:

45 mysqlVolume:

46 driver: local

Remarque : Les variables HAWKULAR_HOST, HAWKULAR_USERNAME, HAWKULAR_PASSWORD lié au conteneur wildfly sont des variables permettant le monitoring du conteneur. Si elles ne sont pas mise en place, aucun monitoring n'est effectué. Dans le cas contraire, elles doivent désigner un serveur hawkular-services avec des accès fonctionnels. Dans notre cas, il s'agit de la seconde composition se trouvant sur ECOM-5. Notez que Hawkular-services doit être lancé avant la création du conteneur wildfly.

ECOM-5

Sur ECOM-5 se trouve deux compositions. La première est très simple et permet de mettre en place . La second est légèrement plus complexe et permet la mise en place d'un système de monitoring de wildfly et donc des conteneurs API-LaReleve.

frontend/docker-compose.yml

1version: '2'

2services:

3 frontal:

4 image: 'gattazr/lareleve-front:latest'

5 ports:

6 - '80:80'

grafana/docker-compose.yml

1version: '2'

2

3services:

4 grafana:

5 image: 'welshstew/hawkular-metrics-grafana'

6 ports:

7 - '3000:3000'

8 cassandra:

9 image: 'cassandra:3.7'

10 environment:

11 CASSANDRA_START_RPC: 'true'

12 hawkular:

13 image: 'hawkularqe/hawkular-services:latest'

14 ports:

15 - '8080:8080'

16 environment:

17 TEST_MODE: 'true'

18 JAVA_OPTS: '-server -Xms64m -Xmx512m -XX:MetaspaceSize=96M -XX:MaxMetaspaceSize=256m -Djava.net.preferIPv4Stack=true -Djboss.modules.system.pkgs=org.jboss.byteman -Djava.awt.headless=true -Dcom.sun.jersey.server.impl.cdi.lookupExtensionInBeanManager=true'

19 DB_TIMEOUT: 180

20 CASSANDRA_NODES: 'cassandra'

21 HAWKULAR_USERNAME: 'jdoe'

22 HAWKULAR_PASSWORD: 'password'

Les Complications

Ressources

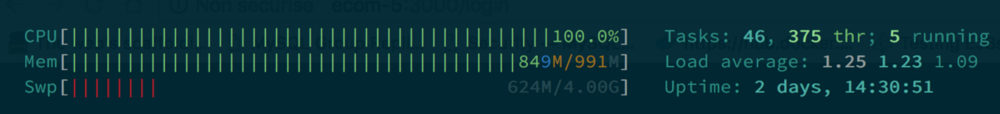

Les machines que nous avons manipulés pendant ce projet ont des ressources très limités. Notamment en mémoire. De ce fait, il peut être intéressant de mettre en place des partitions de SWAP si ce n'est pas des partitions présentes.

Les commandes suivantes permettent la création d'une partition de SWAP de 4Go.

1/bin/dd if=/dev/zero of=/var/swap.1 bs=1M count=1024

2/sbin/mkswap /var/swap.1

3chmod 600 /var/swap.1

4/sbin/swapon /var/swap.1

Réseaux

Suivant les machines utilisés pour faire ce déploiement, des problèmes peuvent apparaitre pour joindre une machine ou une autre. La présence de proxy devant les machines ECOM-3 et ECOM-4 peuvent par exemple amener des problèmes. Aussi, pour faire fonctionner certains services, il peut être nécessaire qu'une certaine topologie réseaux soit mise en place.

L'exemple le plus flagrant vient des machines ECOM-3 et ECOM-4. La réplication de la base de donnée avec MySQL Group Replication (mysql-gr) nécessite que ces deux machines se trouvent sur un même réseau local.